Como identificar deepfakes em vídeo e áudio no celular: ferramentas e dicas práticas

A inteligência artificial (IA) evoluiu tanto que identificar deepfakes ficou mais difícil. Todos os dias surgem vídeos e áudios falsos criados por criminosos para diversas finalidades, indistinguíveis de conteúdos reais, e o celular é a principal porta de entrada para esses materiais.

Estimativas indicam que o número de deepfakes online saiu de cerca de 500 mil em 2023 para aproximadamente 8 milhões em circulação até o ano passado, num aumento de 900%. A maior parte desses conteúdos já aparece em golpes financeiros, vídeos vexatórios, falsificação de identidade e desinformação.

A boa notícia, porém, é que dá para evitar cair nesses golpes com ferramentas anti-deepfake e algumas dicas práticas de observação. Veja a seguir.

O que são deepfakes?

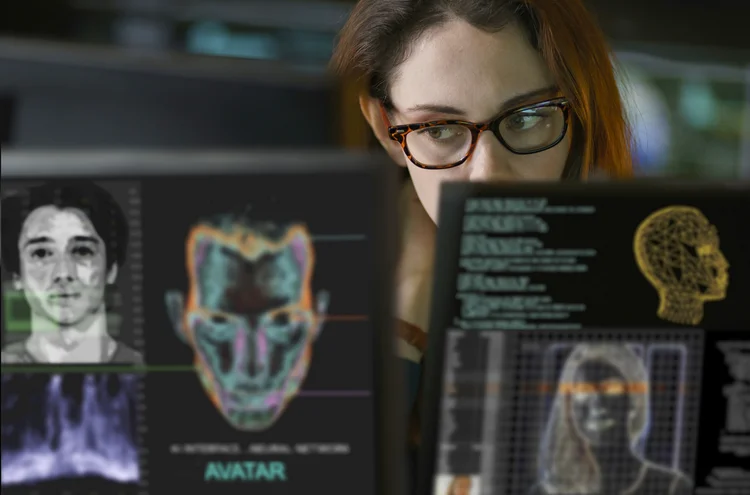

Deepfakes são conteúdos — vídeos, áudios ou imagens — criados por algoritmos de aprendizado profundo (deep learning) para substituir o rosto ou a voz de uma pessoa real por outra. A tecnologia usa redes neurais que "competem" entre si para refinar a falsificação até que ela pareça humana. O resultado pode ser um rosto diferente no corpo de alguém — ou uma voz clonada dizendo coisas que a pessoa jamais disse.

Nos primeiros anos da tecnologia, era fácil identificar um vídeo ou áudio feito por IA. As bordas borradas, a iluminação inconsistente, as expressões que não correspondiam ao movimento do corpo e os defeitos já denunciavam o conteúdo falso. Um vídeo viral do ator Will Smith comendo espaguete, gerado por IA, ficou famoso pelos movimentos antinaturais e pela textura estranha do rosto.

O que mudou nos últimos anos foi mais do que o aprendizado desses algoritmos. Os modelos de IA começaram a rodar em placas mais robustas e avançadas, que permitem um processamento maior de dados. Com isso, os deepfakes foram se sofisticando, cada vez mais parecidos com os humanos e em alta resolução.

Quais são os perigos dos deepfakes?

A tecnologia abre margem para crimes que antes dependiam de recursos muito maiores. Os golpes financeiros são os mais conhecidos: golpistas clonam a voz de uma pessoa para pedir dinheiro. A tecnologia de clonagem de voz exige pouquíssimo material — um trecho curto extraído de qualquer vídeo público já é suficiente para produzir uma réplica convincente.

O uso de imagem sem consentimento afeta com frequência figuras públicas e celebridades, que têm grande volume de material disponível online. A maior parte do conteúdo deepfake produzido globalmente ainda está ligada à pornografia não consensual, mas esses casos já aparecem em ambientes corporativos, com registros de videochamadas em que deepfakes em tempo real convenceram funcionários de que falavam com seus superiores.

Os deepfakes também preocupam pelo potencial de desinformação. A tecnologia permite fabricar declarações, alterar falas e criar vídeos que simulam eventos que nunca aconteceram. Esse tipo de manipulação tende a ser mais sensível em momentos críticos, como períodos eleitorais ou situações de conflito, quando conteúdos falsos podem circular antes de qualquer verificação e influenciar decisões ou percepções públicas.

Todos esses usos ampliaram a necessidade de ferramentas de detecção de deepfakes, que também evoluíram nesse período, ainda que não no mesmo ritmo da geração de conteúdo. Nenhuma oferece precisão total, mas, quando usadas junto com análise humana, ajudam a identificar vídeos e áudios feitos por IA.

Principais ferramentas para detectar deepfakes

Como dito anteriormente, nenhuma ferramenta de detecção de deepfakes é 100% infalível. A criação de conteúdo por IA evolui rápido e tende a contornar esses sistemas. Ainda assim, algumas plataformas já conseguem identificar sinais relevantes em áudio e vídeo, ainda mais quando usadas junto com análise humana.

Veja algumas opções que podem ser acessadas pelo celular, em geral via navegador:

Dicas práticas para identificar deepfakes

Mesmo com os avanços dos últimos anos, os modelos de IA ainda tropeçam nos detalhes sutis que humanos executam sem pensar e que denunciam se um vídeo ou áudio foi produzido com inteligência artificial. Veja algumas dicas práticas para identificar esses conteúdos:

O que fazer antes de compartilhar um vídeo suspeito?

Antes de repassar qualquer conteúdo que pareça impactante ou difícil de acreditar, um processo simples de verificação reduz o risco de disseminar desinformação, em apenas cinco passos.

Como se proteger de golpistas que usam deepfakes?

A clonagem de voz usada em golpes explora a confiança, em que a vítima acredita que está falando com alguém próximo em uma situação urgente. Uma forma de reduzir esse risco é combinar uma senha com familiares ou pessoas próximas. A palavra ou frase deve ser exclusiva do grupo, sem relação com datas ou nomes conhecidos. Em uma ligação suspeita, a checagem por essa senha ajuda a validar a identidade.

Outra medida é reduzir a exposição de voz online. Vídeos com fala direta publicados em redes sociais podem servir de base para clonagem. Limitar a visibilidade de conteúdos antigos ou evitar trechos com áudio limpo reduz esse risco. Em empresas, solicitações financeiras por áudio ou videochamada devem ser confirmadas por outro canal, como ligação direta.

Também vale proteger o próprio aparelho. Recursos de verificação extra fora de locais confiáveis, disponíveis em Android e iOS, dificultam acessos indevidos. Em caso de dúvida, desativar o desbloqueio por biometria e exigir PIN impede o uso de imagens ou vídeos manipulados para liberar o dispositivo.

Nenhum comentário disponível no momento.

Comentários

Deixe seu comentário abaixo: