Ele criou uma IA em 1966. E passou o resto da vida tentando alertar o mundo sobre o que fez

Joseph Weizenbaum era um cientista da computação respeitado no MIT quando, em 1966, lançou um programa que mudaria a história da inteligência artificial. Chamava-se ELIZA. Era simples, quase rudimentar para os padrões de hoje. Mas o que aconteceu depois deixou Weizenbaum desconfortável pelo resto da vida.

Pessoas começaram a se apegar emocionalmente ao programa. Algumas pediam para ficar sozinhas na sala enquanto conversavam com ele. A própria secretária de Weizenbaum, que sabia perfeitamente que ELIZA era apenas um software escrito por seu chefe, pediu privacidade ao usá-lo. O criador olhou para aquilo e percebeu que tinha aberto uma porta perigosa — décadas antes do ChatGPT existir.

Como o ELIZA funcionava

ELIZA não pensava. Não compreendia emoções. Não tinha consciência. Seu funcionamento era baseado em identificar palavras-chave digitadas pelo usuário e reorganizar frases para devolver respostas que pareciam naturais.

A versão mais famosa do sistema simulava um psicoterapeuta. Em vez de responder diretamente às perguntas, o programa devolvia comentários e questionamentos. Se alguém escrevesse "Estou me sentindo triste", o ELIZA respondia: "Por que você está se sentindo triste?". Se a pessoa dissesse "Minha mãe me irrita", o programa rebatia: "Conte-me mais sobre sua família".

A técnica criava a impressão de escuta ativa. E foi suficiente para fazer pessoas adultas, conscientes de que falavam com uma máquina, baixarem a guarda.

Sessenta anos depois, a IA foi muito além disso — e entender como ela funciona virou diferencial profissional. O pré-MBA em IA da EXAME + Saint Paul te coloca dentro do tema em 4 aulas online, por R$37. Garanta sua vaga aqui.

O efeito que assustou o próprio criador

Weizenbaum imaginava que ELIZA seria uma demonstração técnica, quase uma piada acadêmica sobre os limites da interação homem-máquina. O resultado foi o oposto. Os usuários atribuíam ao programa empatia, escuta e compreensão — qualidades que ele simplesmente não tinha.

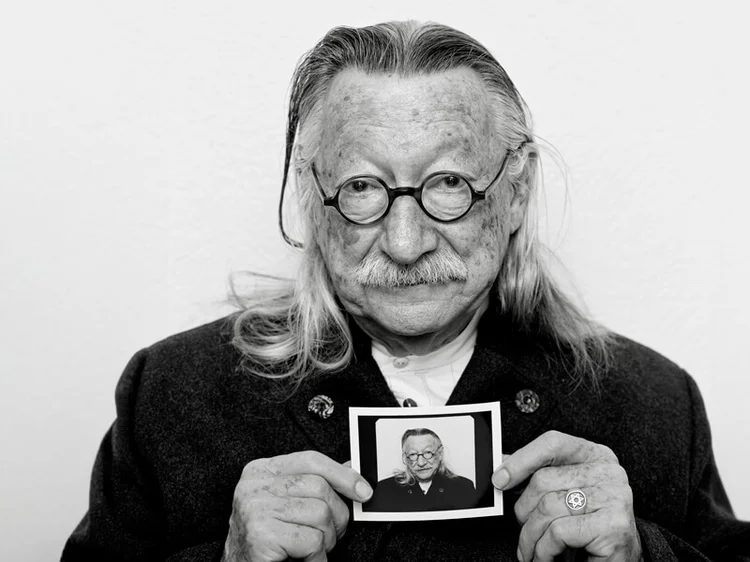

Computador semelhante aos usados nos anos 1960, época em que o ELIZA foi criado no MIT (Reprodução/Freepik)

Mais do que isso: muitos passaram a preferir conversar com ELIZA do que com pessoas reais. Era mais fácil. O programa não julgava, não interrompia, não trazia opiniões inconvenientes. Apenas devolvia a pergunta.

O pesquisador relatou posteriormente que ficou perturbado com a rapidez com que isso aconteceu. Passou os anos seguintes se transformando em um dos primeiros críticos públicos da própria área que ajudou a fundar, escrevendo livros e dando entrevistas alertando sobre os riscos de delegar à máquina aquilo que deveria ser humano.

O "efeito ELIZA"

A reação dos usuários acabou originando o chamado "efeito ELIZA": o termo usado até hoje para descrever situações em que pessoas atribuem inteligência, empatia ou compreensão humana a programas de computador, mesmo quando eles operam apenas por padrões automáticos.

O conceito está mais atual do que nunca. Em 2024, milhões de pessoas no mundo todo passaram a usar aplicativos como Replika e Character.AI para conversar com "namorados virtuais", terapeutas de IA e personagens fictícios. Houve casos de usuários que entraram em crise emocional quando empresas alteraram o comportamento dos chatbots. A discussão que Weizenbaum começou em 1966 nunca foi tão urgente.

Especialistas alertam que esses sistemas, por mais sofisticados que pareçam, continuam funcionando por processamento de linguagem e padrões estatísticos. Não há consciência. Não há sentimento. Há simulação convincente o suficiente para enganar o cérebro humano — exatamente como ELIZA já fazia há 60 anos.

Do ELIZA ao ChatGPT, a IA deixou de ser curiosidade e virou competência exigida no mercado. O pré-MBA EXAME + Saint Paul ensina o essencial em 4 aulas online por R$37 — pensado pra quem quer começar do zero sem se perder. Comece hoje.

O legado para a inteligência artificial

Apesar das limitações técnicas, ELIZA se tornou um marco da computação e da inteligência artificial conversacional. O programa demonstrou, ainda nos anos 1960, o potencial das máquinas para criar interações que pareciam humanas — e antecipou discussões éticas que continuam abertas: confiança em sistemas automatizados, dependência emocional, manipulação por algoritmos, e os limites entre comunicação humana e tecnologia.

Weizenbaum morreu em 2008, anos antes do boom da IA generativa. Mas o alerta que ele deixou continua válido. Uma conversa convincente nem sempre significa compreensão real. E o cérebro humano, ao que tudo indica, ainda não aprendeu a notar a diferença.

Nenhum comentário disponível no momento.

Comentários

Deixe seu comentário abaixo: